Wstępna analiza nagrań audio

Jak napisać artykuł dla Tygodnika Polityka i nie zwariować

W ostatnich miesiącach opublikowałem dwa artykuły w Tygodniku Polityka, oba opierały się na wielomiesięcznej analizie materiałów które zebrałem wcześniej. Pierwszy dotyczył Tygodnika Trybuna i opierał się na analizie archiwalnych skanów tej gazety. Metodologia pracy była prosta - wystarczyło w Bibliotece Narodowej zeskanować archiwalne numery, wykonać OCR i przeszukiwać materiał pod kątem interesujących słów kluczowych. Drugi dotyczył Radia AK Jutrzenka i był dużo większym wyzwaniem - ponieważ wymagał analizy dziesiątek godzin nagrań.

Do tej pory znane mi organizacje, które zajmowały się analizą dźwięku robiły to w dużej mierze ręcznie a jedyną formą przyspieszenia pracy było przyspieszanie nagrań i odsłuch z podwójną prędkością. Dlatego też piszę ten artykuł, żeby podzielić się swoim - dalej dość prostym i prymitywnym sposobem, który może jednak przyspieszyć pracę wielokrotnie.

Zgrywanie materiału

Radio2Podcast

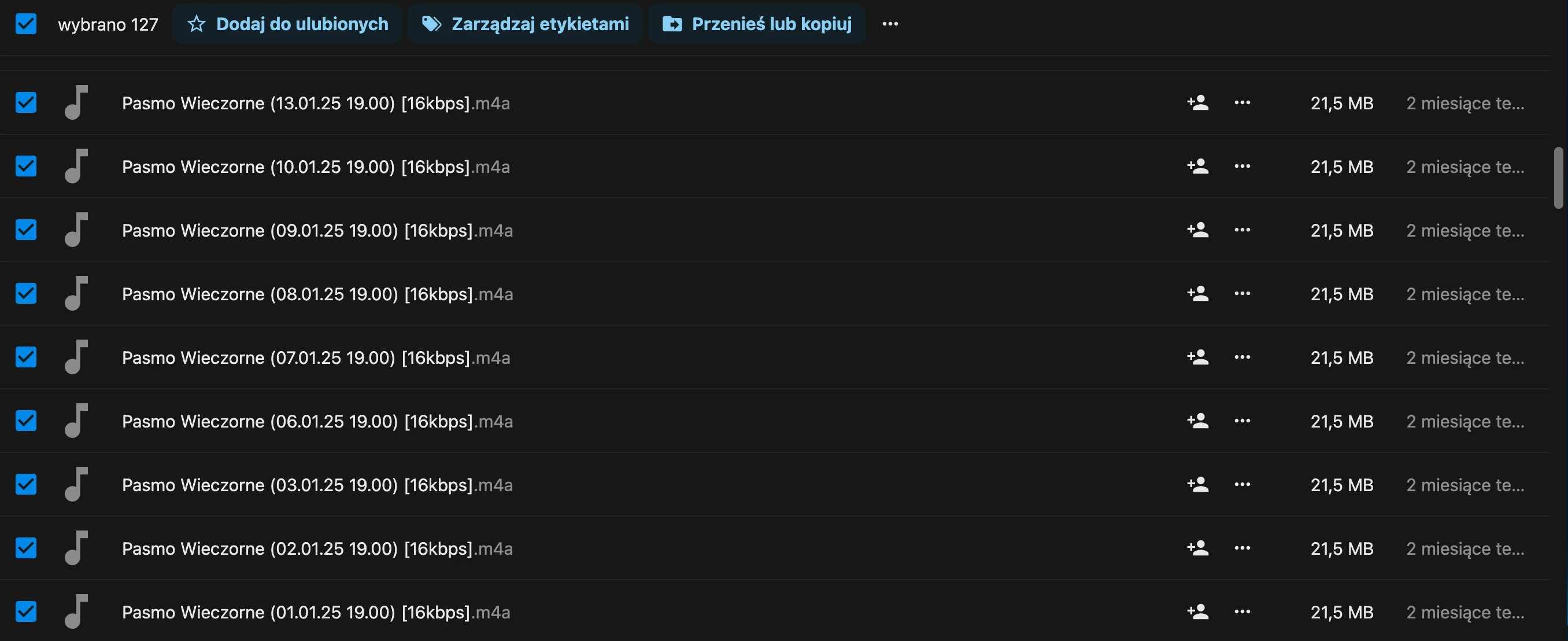

W przypadku mojego artykułu chodziło o radio nadające na falach FM oraz w internecie. Była więc to doskonała okazja, żeby przetestować w działaniu mój skrypt Radio2Podcast, który pozwolił mi zarchiwizować 127 audycji (do momentu opublikowania tego tekstu) bez codziennego pamiętania o włączaniu nagrywania w paśmie publicystycznym. Oczywiście to bardzo specyficzne zastosowanie - ale oszczędziło mi wiele nerwów.

Dlaczego zbierałem tak dużo materiału? Chciałem napisać artykuł jak najpełniejszy i wykazać pewną niezmienność spiskowych narracji. Dzięki temu mogłem udowodnić, że to nie jednostkowy wypadek przy pracy a raczej ciągłość w obrzydzaniu zachodu, NATO, UE przy jednoczesnej pobłażliwości dla Rosji i Chin. Jednocześnie oznaczało to 381 godzin do przesłuchania - ręcznie trudne do zrobienia przez jedną osobę.

yt-dlp

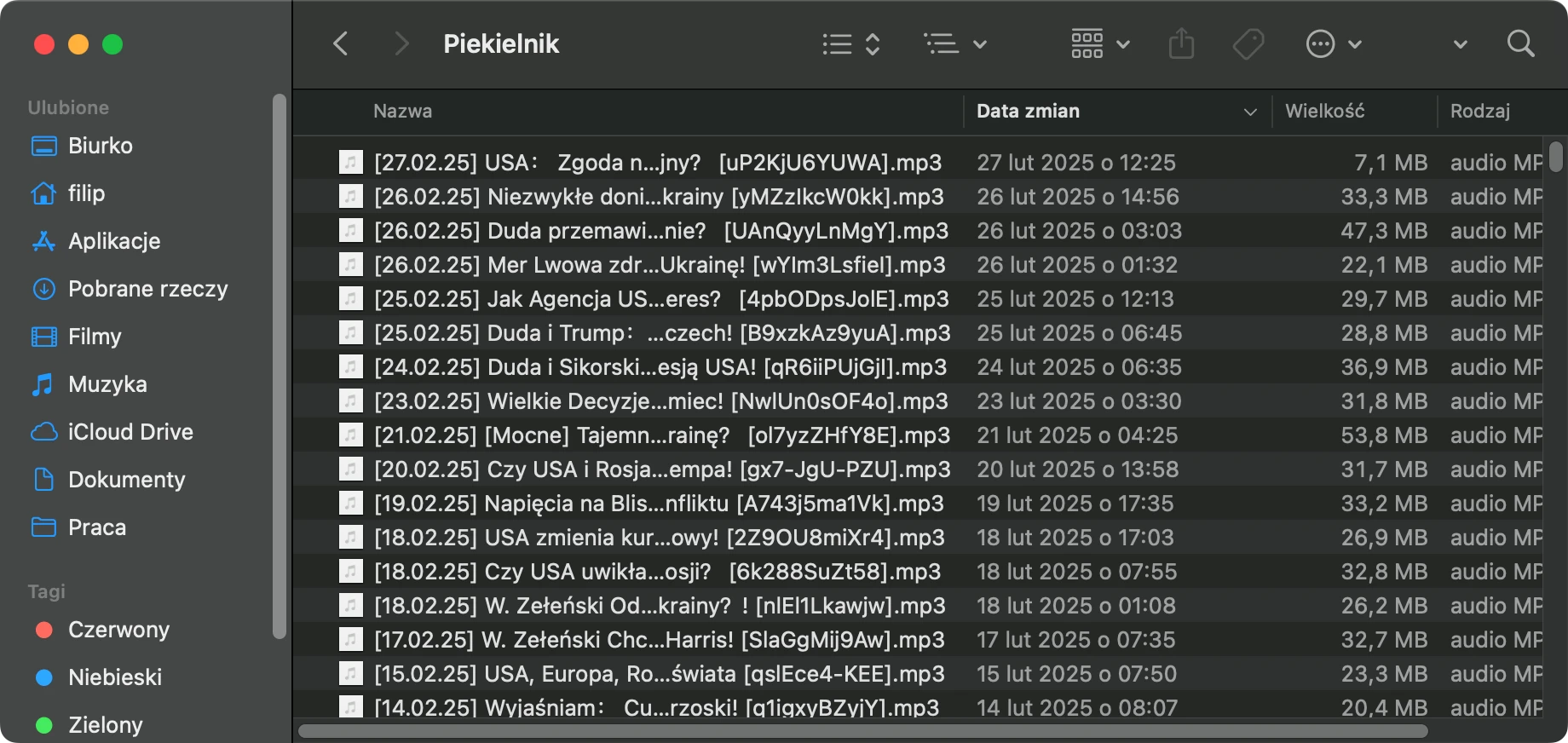

Oczywiście to raczej wyjątkowe zastosowanie, tradycyjne radia FM (oraz internetowe) są ciekawym ale raczej niewielkim wycinkiem rzeczywistości. Równie łatwym, ważnym i ciekawym zastosowaniem byłoby przeanalizowanie kanałów na YouTube, gromadzących dużą widownię. Jak to zrobić? Można skorzystać z narzędzia yt-dlp, które jedną prostą komendą

yt-dlp -x --audio-format mp3 --cookies-from-browser "chrome" "https://www.youtube.com/RadioJutrzenka"

potrafi pobrać wszystkie filmy z interesującego nas kanału (i przekonwertować je na plik mp3).

Praca z dźwiękiem

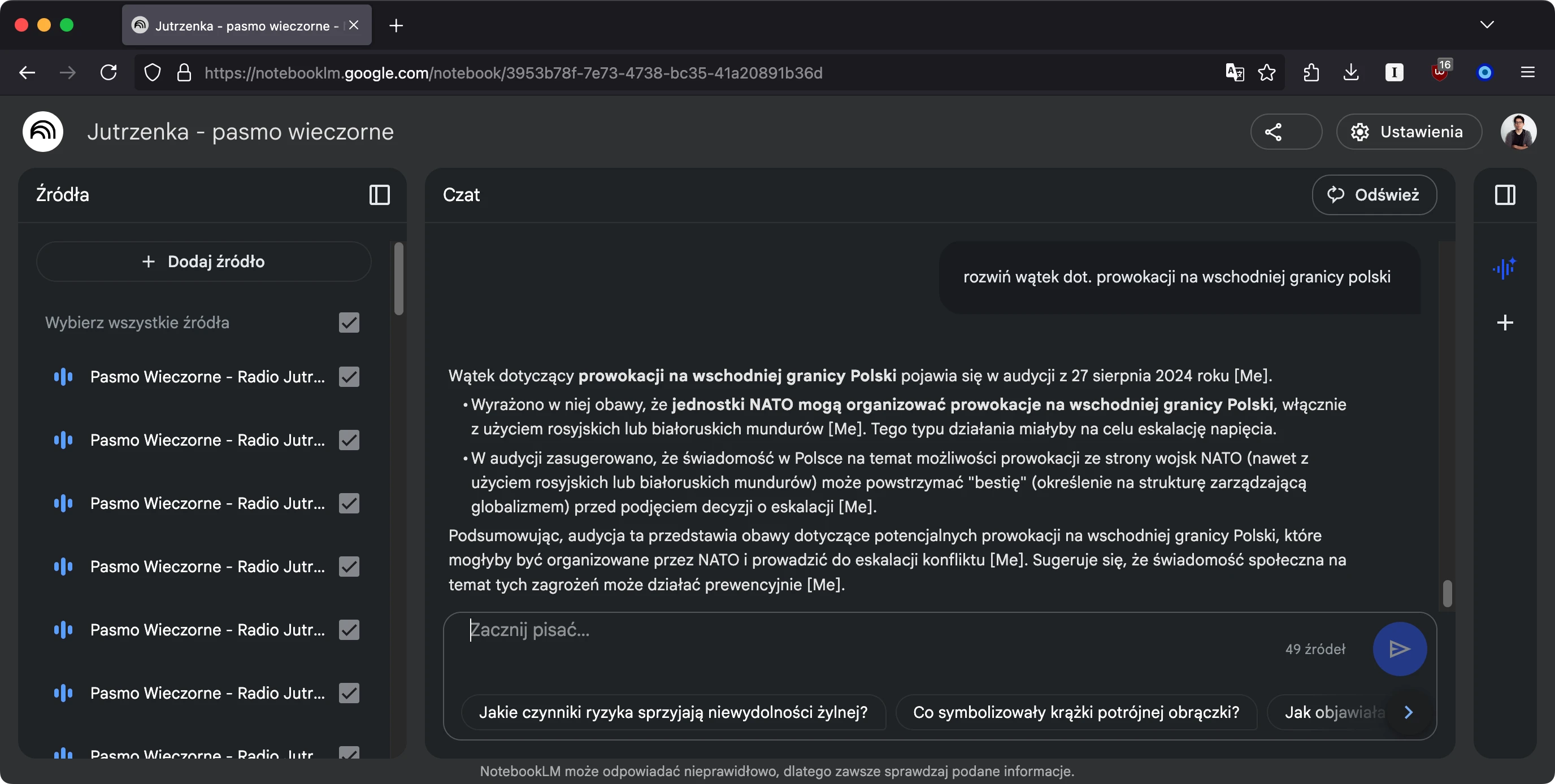

Ostatnim etapem jest analiza zebranego materiału. Ja skorzystałem z Google NotebookLM, czyli darmowego narzędzia AI pozwalającego na analizę przesłanych przez siebie dokumentów. Szczęśliwie wspierane są też pliki dźwiękowe, z których narzędzie robi gotową transkrypcję. W ramach jednego projektu można załączyć 50 nagrań lub innych dokumentów i odpytywać czat z prośbą o ich przeszukiwanie. Oczywiście każde twierdzenie AI trzeba weryfikować bo jak każdemu z tych systemów zdarzają się halucynacje.

Oczywiście nie zawsze możemy pracować online, zwłaszcza jeśli nasze śledztwo dotyczy kwestii wrażliwych, którymi nie chcemy dzielić się z Google (i innymi korporacjami). W takim wypadku konieczne będzie wykonanie transkrypcji lokalnie używając np. darmowegp silnika Whisper a następnie uruchomić jakieś AI lokalnie. Nie mam jednak możliwości technicznych by przeprowadzić podobny eksperyment. To co jest pewne to fakt, że wraz z rozwojem AI poza nowymi problemami pojawiają się też wartościowe i ciekawe rozwiązania, które mogą znacznie przyspieszyć pracę analityczną. I tej pozytywnej myśli się trzymajmy.